El actor de amenaza desconocida ha estado observando la herramienta de inteligencia artificial (IA) generativa V0, y ha diseñado páginas de inicio de sesión falsas que se hacen pasar por contrapartes legales.

«Esta observación ilustra una nueva evolución en el arma de la IA generada por actores de amenaza que demostraron su capacidad para generar sitios de phishing funcionales a partir de simples indicaciones de texto».

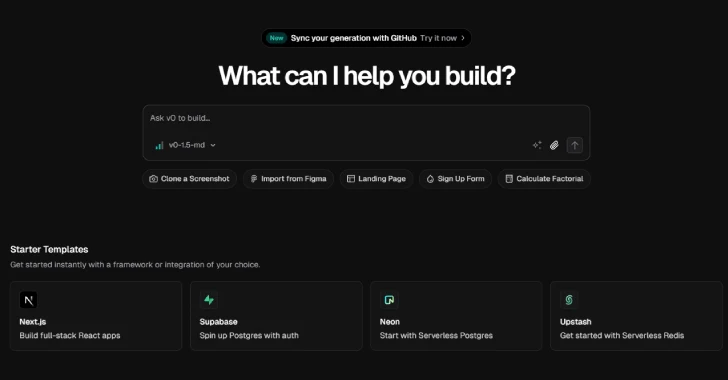

V0 es una oferta impulsada por IA desde VERCEL que permite a los usuarios crear páginas de destino básicas y aplicaciones completas de pila utilizando indicaciones de lenguaje natural.

El proveedor de servicios de identidad dijo que observaba el uso de la tecnología para crear réplicas convincentes de páginas de inicio de sesión asociadas con múltiples marcas, incluidos sus propios clientes sin nombre. Después de la divulgación responsable, Vercel ha bloqueado el acceso a estos sitios de phishing.

También se ha encontrado que los actores de amenaza detrás de la campaña explotan la confianza relacionada con la plataforma de desarrolladores y alojan otros recursos, tal vez el logotipo de la compañía que se hace pasar por la infraestructura de Vercel, para evitar la detección.

A diferencia de los kits de phishing tradicionales, que requieren un esfuerzo para configurar, herramientas como V0 y los clones de código abierto de GitHub permiten a los atacantes girar las páginas falsas simplemente escribiendo un aviso. Es más rápido, más fácil y no se requieren habilidades de codificación. Esto facilita incluso a los actores de amenaza de baja calificación construir sitios de phishing convincentes a escala.

«Las actividades observadas confirman que los actores de amenaza de hoy están experimentando activamente y armando herramientas clave Genai para racionalizar y mejorar sus capacidades de phishing», dijeron los investigadores.

«Las plataformas como V0.dev de Vercelio permiten a los actores de amenaza emergente generar rápidamente páginas de phishing engañosas y de alta calidad, aumentando la velocidad y la escala de las operaciones».

El desarrollo surge a medida que el desarrollo aprovecha los modelos de idiomas ilegales (LLM) para apoyar la actividad criminal y continúa construyendo versiones sin censura de estos modelos, diseñados explícitamente con fines ilegales. Uno de esos LLM que ganó popularidad en el paisaje del delito cibernético es el rabbitneo blanco, promoviendo su estado como «el modelo de IA sin censura del equipo (desarrollado) Secops».

«Los ciberdelincuentes se sienten cada vez más atraídos por violar las LLM sin censura, LLMS diseñados por cibercrimen y LLM legales», dijo Jaeson Schultz, investigador de Cisco Talos.

«Uncensored LLM es un modelo poco conforme que funciona sin restricciones de barandilla. Estos sistemas son de forma sensible, controvertida o potencialmente dañina en respuesta a las indicaciones del usuario. Como resultado, LLM sin censura es perfectamente adecuado para el uso de cibercrimen».

Esto encaja con el mayor cambio que vemos. La pesca es más impulsada por AI que antes. Los correos electrónicos falsos, las voces clonadas e incluso los videos de Deepfake han aparecido en ataques de ingeniería social. Estas herramientas ayudan a los atacantes a escalar rápidamente y convierten pequeñas estafas en grandes campañas automatizadas. Ya no es solo engañar a los usuarios. Es construir un sistema completo de engaño.

Source link