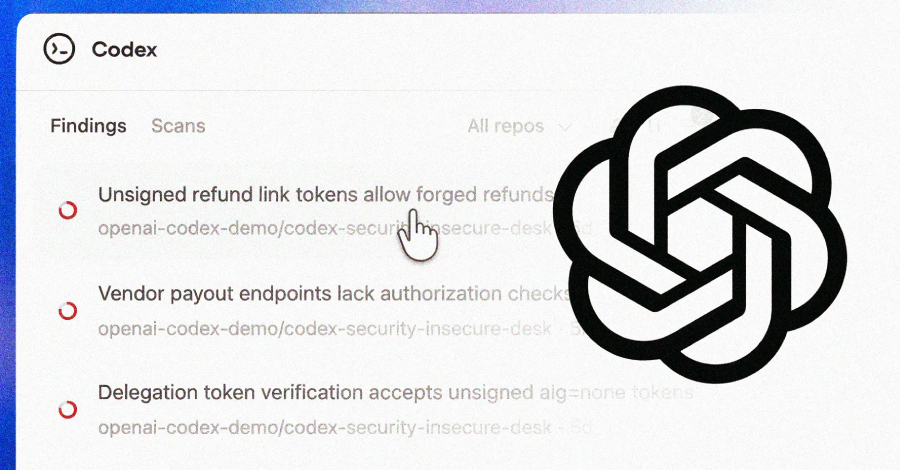

OpenAI comenzó el viernes a implementar Codex Security, un agente de seguridad impulsado por inteligencia artificial (IA) diseñado para descubrir, verificar y sugerir soluciones a vulnerabilidades.

Esta función está disponible como una vista previa de la investigación para los clientes de ChatGPT Pro, Enterprise, Business y Edu a través de Codex Web y estará disponible de forma gratuita el próximo mes.

«Construye un contexto profundo sobre un proyecto para identificar vulnerabilidades complejas que otras herramientas de agentes pasan por alto, descubriendo hallazgos confiables con correcciones que mejoran significativamente la seguridad del sistema y al mismo tiempo protegen a los usuarios del ruido de errores sin importancia», dijo la compañía.

Codex Security es una evolución de Aardvark, que OpenAI lanzó en versión beta privada en octubre de 2025 como una forma para que los desarrolladores y equipos de seguridad detecten y corrijan vulnerabilidades de seguridad a escala.

Durante los últimos 30 días, Codex Security escaneó más de 1,2 millones de confirmaciones en repositorios externos durante el período beta e identificó 792 hallazgos críticos y 10,561 hallazgos de alta gravedad. Estos incluyen vulnerabilidades en varios proyectos de código abierto como OpenSSH, GnuTLS, GOGS, Thorium, libssh, PHP y Chromium. Algunos de ellos se enumeran a continuación:

GnuPG – CVE-2026-24881, CVE-2026-24882 GnuTLS – CVE-2025-32988, CVE-2025-32989 GOGS – CVE-2025-64175, CVE-2026-25242 Torio – CVE-2025-35430, CVE-2025-35431, CVE-2025-35432, CVE-2025-35433, CVE-2025-35434, CVE-2025-35435, CVE-2025-35436

La última versión de su agente de seguridad de aplicaciones aprovecha las capacidades de inferencia de los modelos Frontier y las combina con la validación automática para minimizar el riesgo de falsos positivos y proporcionar una solución procesable, según la empresa de IA.

Los escaneos de OpenAI en los mismos repositorios demostraron una mayor precisión y menores tasas de falsos positivos con el tiempo, y estas últimas cayeron más del 50 % en todos los repositorios.

En una declaración compartida con The Hacker News, OpenAI dijo que Codex Security está diseñado para mejorar la relación señal-ruido al enraizar los descubrimientos de vulnerabilidades en el contexto del sistema y validar los hallazgos antes de presentarlos a los usuarios.

En concreto, el agente trabaja en tres pasos. Esto significa que analiza su repositorio para comprender la estructura del sistema relacionada con la seguridad de su proyecto y genera un modelo de amenaza editable que comprende su comportamiento y dónde está en mayor riesgo.

Una vez que se establece el contexto del sistema, Codex Security lo utiliza como base para identificar vulnerabilidades y categorizar los hallazgos en función de su impacto en el mundo real. Los problemas marcados se someten a pruebas de presión y se validan en un entorno de pruebas.

«Cuando Codex Security se configura en un entorno adaptado al proyecto, los problemas potenciales se pueden examinar directamente en el contexto del sistema en ejecución», dijo OpenAI. «Esa validación más profunda reduce aún más los falsos positivos y permite la creación de una prueba de concepto funcional, lo que brinda a los equipos de seguridad pruebas más sólidas y un camino más claro hacia la remediación».

En la etapa final, el agente sugiere las soluciones que mejor se adaptan al comportamiento del sistema para reducir las regresiones y facilitar la revisión y la implementación.

La noticia de Codex Security llega semanas después de que Anthropic lanzara Claude Code Security para ayudar a los usuarios a escanear bases de código de software en busca de vulnerabilidades y sugerir parches.

Source link