La administración Trump presentó el viernes el marco legal para la única política sobre IA en Estados Unidos. El marco se adelantaría a las leyes estatales sobre IA y centralizaría el poder en Washington, lo que podría socavar los esfuerzos recientes de los estados para regular el uso y desarrollo de la tecnología.

Una declaración de la Casa Blanca sobre el marco dice: «Este marco sólo puede tener éxito si se aplica uniformemente en todo Estados Unidos». «Un mosaico de leyes estatales en conflicto socavará la innovación y la capacidad de Estados Unidos para liderar la carrera mundial de la IA».

El marco describe siete objetivos clave que priorizan la innovación y la expansión de la IA, y propone un enfoque federal centralizado que anula las regulaciones estatales más estrictas. Asigna una responsabilidad significativa a los padres en cuestiones como la seguridad infantil y establece expectativas relativamente suaves y no vinculantes para la responsabilidad de la plataforma.

Por ejemplo, el Congreso ha dicho que se debería exigir a las empresas de inteligencia artificial que implementen características que «reduzcan el riesgo de explotación sexual y daño a menores», pero no ha establecido requisitos claros y exigibles.

El marco del presidente Trump llega tres meses después de que firmara una orden ejecutiva que ordena a las agencias federales desafiar las leyes estatales de IA. La orden le dio al Departamento de Comercio 90 días para crear una lista de leyes estatales «onerosas» sobre IA que podrían poner en peligro la elegibilidad de los estados para recibir fondos federales, como los subsidios de banda ancha. La agencia aún no ha publicado la lista.

La orden también ordenó a la administración trabajar con el Congreso en una ley uniforme de IA. Esa visión está ganando terreno y refleja la anterior estrategia de IA del presidente Trump, que se centraba más en acelerar el crecimiento corporativo que en las barreras de seguridad.

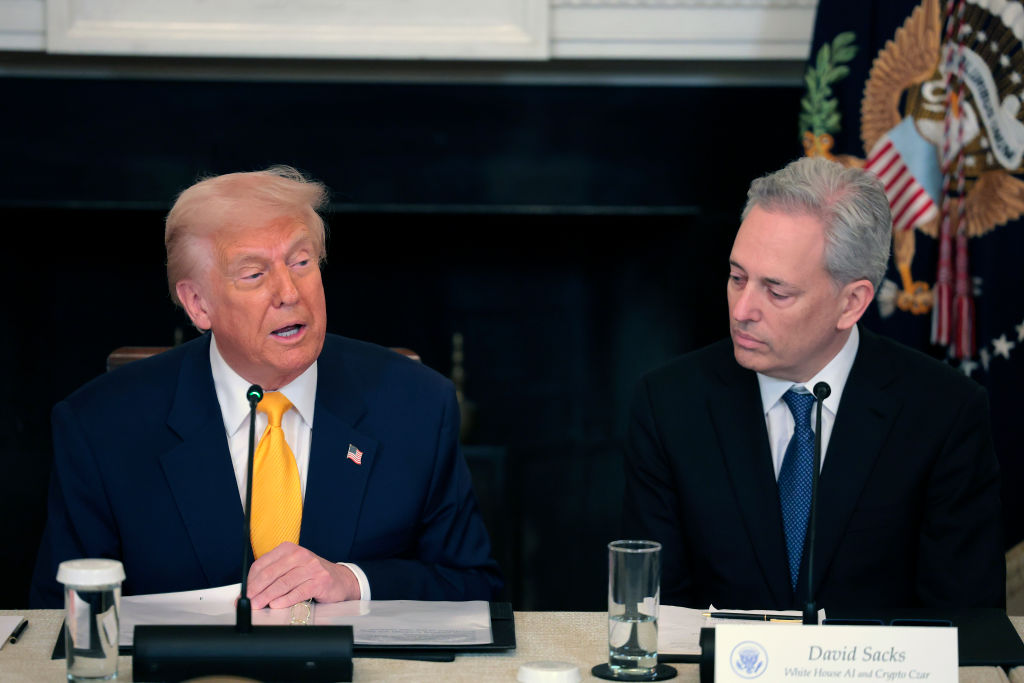

El nuevo marco propone «estándares nacionales con la menor carga» y refleja el impulso más amplio de la administración para «eliminar barreras obsoletas o innecesarias a la innovación» y acelerar la adopción de la IA en todas las industrias. Este es el enfoque regulatorio ligero y favorable al crecimiento favorecido por los “aceleracionistas” como el zar de la IA de la Casa Blanca y el capitalista de riesgo David Sachs.

evento de crisis tecnológica

San Francisco, California

|

13-15 de octubre de 2026

Aunque este marco refleja el federalismo, los estados conservan poderes relativamente limitados, sólo sobre leyes generales como el fraude, la protección infantil, la zonificación y el uso estatal de la IA. Ha adoptado una postura firme contra la regulación estatal del propio desarrollo de la IA, calificando el desarrollo de la IA como una cuestión «esencialmente interestatal» relacionada con la seguridad nacional y la política exterior.

El marco también tiene como objetivo evitar que los estados «castiguen a los desarrolladores de IA por la conducta ilegal de terceros involucrados en sus modelos», proporcionando un importante escudo de responsabilidad para los desarrolladores.

El marco carece de compromiso con marcos de rendición de cuentas, supervisión independiente o mecanismos de aplicación de nuevos daños que pueda causar la IA. De hecho, este marco centraliza la formulación de políticas de IA en Washington al tiempo que reduce el margen para que los estados actúen como reguladores tempranos de los riesgos emergentes.

Los críticos argumentan que los estados son entornos de pruebas democráticos que promulgan leyes más rápidamente para evitar nuevos riesgos. Específicamente, la Ley RAISE de Nueva York y la SB-53 de California tienen como objetivo garantizar que las grandes empresas de IA cumplan con los protocolos de seguridad documentados públicamente.

“El zar de la IA de la Casa Blanca, David Sachs, sigue cediendo ante las grandes tecnologías a expensas de los estadounidenses comunes y trabajadores”, dijo Brendan Steinhauser, director ejecutivo de The Alliance for Secure AI. «Este marco federal de IA tiene como objetivo impedir que los estados promulguen legislación sobre IA y no proporciona ninguna vía para responsabilizar a los desarrolladores de IA por los daños causados por sus productos de IA».

Muchos en la industria de la IA acogen con agrado esta dirección, ya que les brinda mayor libertad para “innovar” sin la amenaza de la regulación.

«Este marco es exactamente lo que las startups han estado buscando: un estándar nacional claro para ayudar a las empresas a construir y escalar rápidamente», dijo a TechCrunch Teresa Carlson, presidenta del General Catalyst Institute. «Los fundadores no deberían tener que navegar por un mosaico de leyes estatales contradictorias sobre IA que sofocan la innovación».

Seguridad infantil, derechos de autor y libertad de expresión

El marco llega en un momento en que la seguridad infantil se ha convertido en un punto central del debate sobre la IA. Algunos estados están tomando medidas agresivas para aprobar leyes destinadas a proteger a los menores y hacer que las empresas de tecnología sean más responsables. La propuesta de la administración toma una dirección diferente, centrándose más en el control parental que en la responsabilidad de la plataforma.

«Los padres están en la mejor posición para gestionar el entorno digital y la educación de sus hijos», dice el marco. «La Administración está pidiendo al Congreso que proteja la privacidad de los niños y brinde a los padres las herramientas para hacerlo de manera efectiva, incluidos controles de cuentas para administrar el uso de los dispositivos».

El marco también establece que la administración «cree» que las plataformas de IA deberían «implementar características que reduzcan la posible explotación sexual de niños y el fomento de la autolesión». La propuesta insta al Congreso a exigir tales salvaguardias y confirma que las leyes existentes, incluidas las leyes que prohíben el material de abuso sexual infantil, deben aplicarse a los sistemas de inteligencia artificial, pero la propuesta utiliza calificativos como «comercialmente razonable» y no llega a establecer condiciones previas claras.

En cuanto al tema de los derechos de autor, el marco busca encontrar un compromiso entre proteger a los creadores y permitir que los sistemas de inteligencia artificial se entrenen en obras existentes, citando la necesidad de un «uso justo». Este tipo de lenguaje refleja los argumentos de las empresas de IA, que se enfrentan a un número creciente de demandas por derechos de autor sobre datos de entrenamiento.

Las principales barreras de seguridad del marco de IA del presidente Trump parecen incluir garantizar que «la IA pueda perseguir la verdad y la precisión sin restricciones». Específicamente, se centra en prevenir la censura gubernamental, más que en la moderación de la plataforma en sí.

«El Congreso debería impedir que el gobierno de Estados Unidos obligue a los proveedores de tecnología, incluidos los proveedores de inteligencia artificial, a prohibir, coaccionar o cambiar contenido en función de objetivos partidistas o ideológicos», se lee en el marco. También ordena al Congreso que proporcione una vía para que los estadounidenses busquen reparación legal contra las agencias gubernamentales que censuran el discurso en las plataformas de inteligencia artificial o intentan dictar la información que brindan.

El marco se produce cuando Anthropic está demandando al gobierno por violar sus derechos de la Primera Enmienda después de que el Departamento de Defensa (DOD) lo identificara como un riesgo para la cadena de suministro. Antropic afirma que la designación es una represalia por la negativa del Pentágono a permitir que el ejército utilice sus productos de inteligencia artificial para la vigilancia masiva de estadounidenses o para determinar los objetivos y el disparo de armas autónomas letales. El presidente Trump llamó a Anthropic y a su director ejecutivo, Dario Amodei, «despertados» e «izquierdistas radicales».

El lenguaje del marco, que enfatiza la protección de la «expresión política legítima y la disidencia», parece basarse en la orden ejecutiva anterior del presidente Trump dirigida a la «IA despierta», que alentó a las agencias federales a implementar sistemas considerados ideológicamente neutrales.

Debido a que no está claro qué constituye censura y moderación de contenido estándar, ese lenguaje podría dificultar que los reguladores coordinen con las plataformas en cuestiones como la desinformación, la interferencia electoral y los riesgos para la seguridad pública.

«Si bien[el marco]establece correctamente que el gobierno no debe obligar a las empresas de IA a prohibir o cambiar el contenido basándose en ‘objetivos partidistas o ideológicos’, la orden ejecutiva de la administración sobre la ‘IA despierta’ de este verano hace precisamente eso», dijo Samir Jain, vicepresidente de políticas del Centro para la Tecnología Democrática.

Source link