El desafío cuando se habla de modelos de aprendizaje profundo suele ser comprender por qué el modelo se comporta como lo hace. Ya sean las repetidas sesiones de lucha de xAI para afinar las extrañas políticas de Grok o las luchas de ChatGPT con aduladores y alucinaciones mundanas, conectar redes neuronales con miles de millones de parámetros no es fácil.

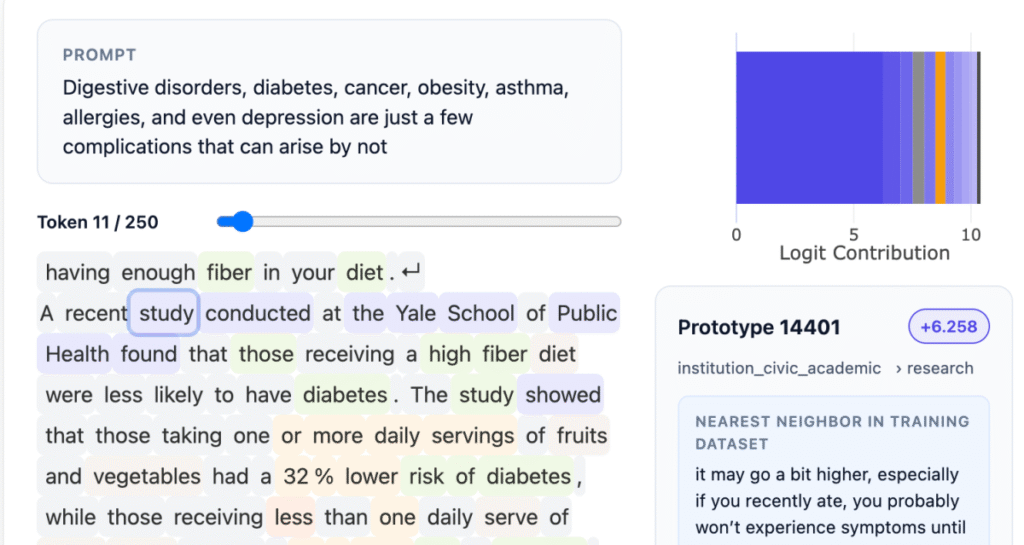

Guide Labs, una startup de San Francisco fundada por el director ejecutivo Julius Adebayo y la directora científica Aya Abdelsalam Ismail, ofrece hoy una respuesta a esa pregunta. El lunes, la compañía abrió Steelling-8B, un LLM de 8 mil millones de parámetros capacitado en una nueva arquitectura diseñada para hacer que las acciones sean más fáciles de interpretar. Todos los tokens generados por el modelo se pueden rastrear hasta el origen de los datos de entrenamiento del LLM.

Esto puede ser tan simple como determinar qué referencias fácticas cita el modelo, o tan complejo como comprender la comprensión del modelo sobre el humor o el género.

«Si hay un billón de formas de codificar el género, y lo codifico en mil millones de los billones de cosas que tengo, tengo que asegurarme de poder encontrar los mil millones de cosas que codifiqué. Y tengo que poder encenderlo y apagarlo de manera confiable», dijo Adebayo a TechCrunch. «Se puede hacer eso con el modelo actual, pero es muy frágil… Es una de esas preguntas del santo grial».

Adebayo comenzó esta investigación mientras completaba su doctorado en el MIT y es coautor de un artículo de 2018 ampliamente citado que muestra que los métodos existentes para comprender los modelos de aprendizaje profundo no son confiables. En última instancia, ese trabajo condujo a la creación de una nueva forma de crear un LLM. Los desarrolladores insertan capas conceptuales en el modelo que clasifican los datos en categorías que se pueden rastrear. Esto requiere más anotaciones de datos iniciales, pero al aprovechar otros modelos de IA, pudimos entrenar este modelo como nuestra prueba de concepto más grande hasta la fecha.

«El tipo de interpretabilidad que hace la gente… es neurociencia basada en modelos, y le damos la vuelta», dijo Adebayo. «Lo que realmente estamos haciendo es diseñar un modelo desde cero para no tener que hacer nada de neurociencia».

Una preocupación con este enfoque es que puede eliminar algunos de los nuevos comportamientos que hacen que el LLM sea tan interesante: la capacidad de generalizar de nuevas maneras sobre cosas que aún no han sido entrenadas. Adebayo dice que eso todavía sucede en el modelo de su empresa. Su equipo rastrea lo que llama «conceptos descubiertos», que los modelos descubren por sí solos, de forma muy parecida a la computación cuántica.

evento de crisis tecnológica

bostón, massachusetts

|

9 de junio de 2026

Adebayo sostiene que esta arquitectura interpretable será algo que todos necesitarán. Para los LLM de consumo, los creadores de modelos podrán utilizar estas técnicas para bloquear el uso de material protegido por derechos de autor y controlar mejor la producción sobre temas como la violencia y el abuso de sustancias. Las industrias reguladas requieren LLM más controlables. Por ejemplo, en la industria financiera, los modelos que evalúan a los solicitantes de préstamos deberían considerar aspectos como el historial financiero en lugar de la raza. También existe la necesidad de interpretabilidad en la investigación científica, otra área en la que Guide Labs ha desarrollado tecnología. El plegamiento de proteínas ha sido un gran éxito para los modelos de aprendizaje profundo, pero los científicos necesitan más información sobre por qué el software encuentra combinaciones prometedoras.

«Este modelo muestra que entrenar modelos interpretables ya no es una especie de ciencia, sino un problema de ingeniería», dijo Adebayo. «Hemos descifrado la ciencia y hemos podido ampliarla. No hay ninguna razón por la que este tipo de modelo no pueda igualar el rendimiento de los modelos de nivel de frontera con más parámetros».

Según Guide Labs, Steelling-8B puede alcanzar el 90% de la potencia de los modelos existentes, pero utiliza menos datos de entrenamiento gracias a su nueva arquitectura. Los próximos pasos de la compañía, que surgió de Y Combinator y recaudó una ronda inicial de $ 9 millones de Initialized Capital en noviembre de 2024, son construir un modelo más grande y comenzar a ofrecer API y acceso de agentes a los usuarios.

«La forma actual en que entrenamos modelos es tan primitiva que democratizar la interpretabilidad inherente será bueno para nuestro papel en la humanidad a largo plazo», dijo Adebayo a TechCrunch. «Estamos persiguiendo estos modelos que serán súper inteligentes, por lo que no querrás que algo misterioso tome decisiones por ti».

Source link