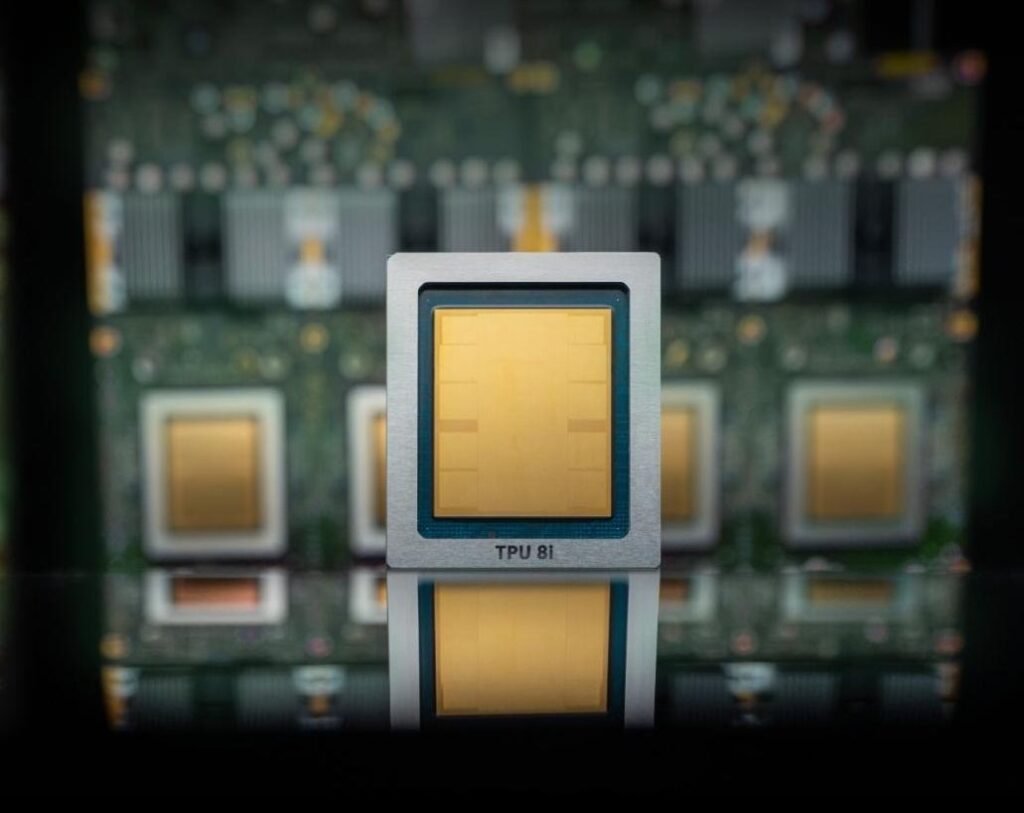

Google Cloud anunció el miércoles que su octava generación de chips de IA personalizados, o unidades de procesamiento tensorial (TPU), se dividirá en dos. Un chip, llamado TPU 8t, está dedicado al entrenamiento de modelos, y el otro chip, TPU 8i, está destinado a la inferencia.

La inferencia es el uso continuo del modelo, lo que sucede después de que el usuario envía el mensaje.

Como era de esperar, la compañía está promocionando las especificaciones de rendimiento superiores de estos nuevos TPU en comparación con la generación anterior. Esto significa que puede entrenar modelos de IA hasta 3 veces más rápido, obtener un 80 % más de rendimiento por dólar y tener más de 1 millón de TPU trabajando juntos en un solo clúster. El resultado debería ser mucha menos energía y más computación a costo del cliente que las versiones anteriores. Los chips personalizados de bajo consumo de la compañía se denominaron originalmente Tensores, razón por la cual los llamamos TPU en lugar de GPU.

Pero los chips de Google no son un ataque total al futuro de Nvidia, al menos por ahora. Google, al igual que otros proveedores gigantes de la nube como Microsoft y Amazon, está utilizando estos chips para complementar los sistemas basados en Nvidia que ofrece en su propia infraestructura. No es un reemplazo completo de Nvidia. De hecho, Google está potenciando su nube con el último chip de Nvidia, Vera Rubin, que promete estará disponible a finales de este año.

Los hiperescaladores que desarrollan sus propios chips de IA (como Amazon, Microsoft y Google) algún día podrían reducir la necesidad de Nvidia a medida que las empresas trasladen sus necesidades de IA a sus propias nubes y transfieran sus aplicaciones a estos chips.

Aún así, tal como están las cosas, apostar por Nvidia no vale la pena. Como publicó en broma el destacado analista del mercado de chips Patrick Moorehead en X, allá por 2016, cuando el gigante de las búsquedas lanzó su primer TPU, predijo que el TPU de Google podría ser una mala noticia para Nvidia (e Intel). Nvidia es ahora una empresa con una capitalización de mercado de casi 5 billones de dólares, lo que significa que esta predicción no ha resistido exactamente la prueba del tiempo.

Si todo va según los planes de Nvidia, el crecimiento de Google como proveedor de inteligencia artificial en la nube significará aún más negocios para el fabricante de chips, a pesar de que muchas cargas de trabajo se ejecutarán en los chips de Google.

evento de crisis tecnológica

San Francisco, California

|

13-15 de octubre de 2026

De hecho, Google también dijo que acordó trabajar con Nvidia para diseñar redes de computadoras que permitirán que los sistemas basados en Nvidia se ejecuten de manera más eficiente en su nube. En particular, los dos gigantes tecnológicos están trabajando para mejorar una tecnología de red basada en software llamada Falcon. Falcon fue desarrollado y de código abierto por Google en 2023 en el marco del Open Computing Project, el padrino de todas las organizaciones de hardware de centros de datos de código abierto.

Si compra a través de enlaces en nuestros artículos, podemos ganar una pequeña comisión. Esto no afecta la independencia editorial.

Source link