Judy Hill, subdirectora de Computación de alto rendimiento del Laboratorio Nacional Lawrence Livermore (LLNL), habla sobre el Centro de Computación de Alto Rendimiento de Livermore Computing y las investigaciones innovadoras que se llevan a cabo allí.

La Computación de Alto Rendimiento (HPC) permite el descubrimiento y la innovación a través de las extraordinarias simulaciones que permite. La HPC ocupa ahora un lugar destacado en la lista de prioridades de Estados Unidos para aprovechar su potencial para ahorrar energía, reducir las emisiones, aumentar la competitividad y fortalecer la posición de la nación como líder tecnológico global. En instalaciones del Departamento de Energía de EE. UU. (DOE), como el Laboratorio Nacional Lawrence Livermore (LLNL), la HPC se ha convertido en el «tercer pilar» de la investigación, reuniendo la teoría y la experimentación como socios iguales.

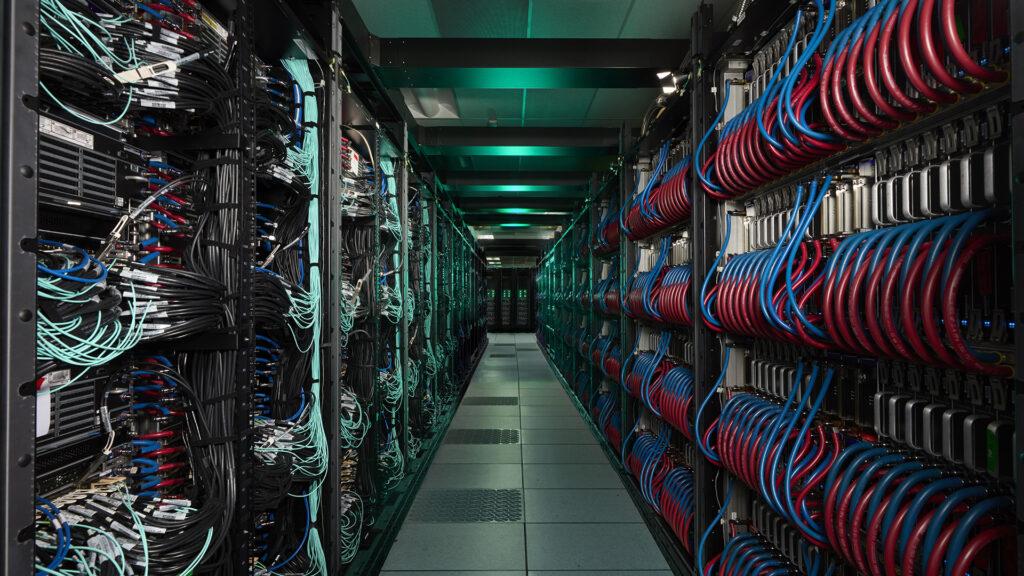

Livermore Computing, el principal centro HPC de LLNL, proporciona los sistemas, las herramientas y la experiencia que respaldan los avances en las capacidades HPC. La misión del centro es triple.

Para obtener más información sobre el trabajo que se realiza en Livermore Computing y el potencial que tiene para una amplia gama de aplicaciones del mundo real, The Innovation Platform habló con Judy Hill, subdirectora de Computación de alto rendimiento de LLNL.

¿Puede explicar brevemente cómo contribuye LLNL al entorno de HPC en los EE. UU. y en todo el mundo?

LLNL ha sido líder en HPC durante décadas desde la fundación del instituto. La primera compra importante de computadora por parte del Instituto fue UNIVAC 1 en 1953, y la informática ha sido fundamental para nuestra misión desde entonces. Esa tradición continúa hoy y seguimos superando los límites de algunas maneras importantes.

Primero, está el hardware en sí. Recientemente pusimos en línea El Capitan, la supercomputadora comparada más rápida del mundo, que ofrece casi 2 exaflops (2 quintillones de cálculos por segundo) de potencia de cálculo, logrando un rendimiento de exaescala. Antes de eso, operó Sierra y Lassen, sistemas esenciales para todo, desde simulación de armas hasta descubrimiento de ciencia de materiales, inteligencia artificial (IA) avanzada e investigación de aprendizaje automático. Estas no son sólo grandes máquinas, son herramientas que nos permiten abordar problemas que antes no tenían solución.

Para dar vida a estas supercomputadoras avanzadas, trabajamos estrechamente con empresas como HPE, AMD, NVIDIA e Intel en asociaciones de codiseño. Diseñamos en colaboración estos sistemas para satisfacer las necesidades específicas de su aplicación. Por ejemplo, AMD MI300A de El Capitan es una unidad de procesamiento acelerado (APU) que utiliza memoria compartida para combinar la funcionalidad de unidad de procesamiento central (CPU) y unidad de procesamiento de gráficos (GPU) en un solo paquete. Este diseño surgió de aportes directos sobre cargas de trabajo que requerían una estrecha integración de CPU y aceleradores de computación de uso general, como GPU, pero sin los cuellos de botella de chips separados.

Otra parte importante de nuestro impacto proviene del desarrollo de software de código abierto. Hemos lanzado docenas de proyectos en GitHub en los que confía la comunidad HPC en general, incluido Spack para la gestión de paquetes y Flux para la gestión de cargas de trabajo. Una vez que resuelva un problema del sistema, comparta su solución para que otros puedan beneficiarse. Esta es la base de cómo contribuimos al ecosistema HPC más amplio.

Finalmente, invertimos en nuestra gente. Capacitamos a la próxima generación de científicos computacionales a través de programas de verano e iniciativas educativas, y compartimos lo que aprendemos con la comunidad en general. Todo esto es parte de mantener a Estados Unidos a la vanguardia de la informática y al mismo tiempo garantizar que resuelvamos problemas importantes.

¿Cuáles son las principales prioridades actuales de Livermore Computing y cómo encajan con los objetivos nacionales e internacionales de HPC?

Nuestras prioridades abarcan tanto desafíos operativos a corto plazo como iniciativas estratégicas a largo plazo. A corto plazo, estamos enfocados en ayudar a los usuarios a utilizar El Capitán de manera eficiente. Esto incluye no solo optimizar el código de su aplicación, sino también permitirle integrar capacidades de IA en sus flujos de trabajo. De cara al futuro, creemos que estamos al borde de un cambio fundamental en la informática científica y la HPC. En el futuro, creemos que los usuarios esperarán interactuar con entornos HPC de una manera similar a los entornos de nube, en lugar de los sistemas monolíticos programados por lotes del pasado.

Operación y utilización eficiente de El Capitán

Aunque El Capitán está activo, nuestra principal prioridad es continuar optimizando su rendimiento y ayudar a que las aplicaciones aprovechen al máximo sus funciones. Esto significa ajustar el código crítico para la arquitectura MI300A y desarrollar un modelo de memoria que aproveche eficientemente el diseño único de memoria de la APU para maximizar la utilización y confiabilidad del sistema.

Integrando IA y aprendizaje automático

La IA está en todas partes y Livermore Computing no es una excepción. Como parte de la misión Génesis del Departamento de Energía, estamos habilitando rápidamente capacidades de IA para mejorar la productividad de los desarrolladores de aplicaciones al crear software para El Capitán y otros sistemas. También estamos utilizando modelos de aprendizaje automático para acelerar las simulaciones físicas, desarrollando modelos sustitutos que puedan reemplazar los costosos cálculos y aplicando IA al análisis de datos de experimentos y simulaciones.

Evolucionando hacia el centro HPC del futuro

También nos centramos en el futuro de HPC. En términos de arquitectura del sistema, ya estamos trabajando con proveedores de tecnología en la próxima generación de subsistemas de memoria e interconexiones que serán fundamentales para las futuras supercomputadoras. Seguimos manteniendo un diálogo activo con los diseñadores de chips para resaltar las características que necesitan para sus aplicaciones mientras consideran futuros diseños de CPU, GPU y otros aceleradores. Pero la verdadera transformación puede ser la convergencia de las metodologías de la nube y el ecosistema HPC. A los usuarios no necesariamente les importa qué sistema resuelve su problema, solo les importa obtener la respuesta correcta en un plazo conocido. Estamos trabajando para transformar el ecosistema HPC en algo más parecido a la «nube» y mejorar la experiencia general de los usuarios finales.

¿Cuáles son los principales desafíos que amenazan la innovación en HPC y cómo se pueden superar?

El panorama de HPC está evolucionando rápidamente y presenta oportunidades interesantes y desafíos importantes que darán forma al futuro. Históricamente, HPC ha superado barreras aprovechando tendencias más amplias de la industria, como el paso de procesadores vectoriales a grupos de productos básicos, el aumento de la aceleración de GPU y ahora la integración con la computación en la nube. Esta capacidad de adaptarse e innovar seguirá siendo una fortaleza fundamental para afrontar los desafíos futuros.

Revolución de la IA y competencia por los recursos

El crecimiento explosivo de la IA y el aprendizaje automático presenta tanto oportunidades como amenazas para la HPC tradicional. Si bien las tecnologías de IA pueden mejorar el modelado y la simulación a través de modelos sustitutos y análisis de datos mejorados, las inversiones comerciales masivas en IA están remodelando el entorno informático de maneras que pueden no alinearse con nuestras necesidades (HPC). Los fabricantes de GPU están optimizando cada vez más sus productos para cargas de trabajo de inferencia y entrenamiento de IA que pueden aprovechar la aritmética de menor precisión, en lugar de la informática científica y técnica tradicional, que a menudo requiere un rendimiento de punto flotante de doble precisión. La enorme demanda de computación con IA también está elevando los costos y creando restricciones en el suministro de aceleradores de alta gama. Este es un caso en el que HPC necesita adaptarse a tendencias más amplias de la industria considerando las oportunidades que pueden brindar los algoritmos de precisión mixta y expandiendo la conversación y los casos de uso a «HPC e IA» en lugar de «HPC o AI».

Cambio de paradigma en la computación en la nube

Aunque la computación en la nube tiene muchos beneficios, la integración con la HPC tradicional presenta desafíos. La economía de la computación en la nube no siempre es favorable para cargas de trabajo continuas y de alta utilización, que son típicas de la mayoría de las campañas de simulación de HPC. También existen diferencias culturales y de flujo de trabajo entre los usuarios de HPC tradicionales y los enfoques nativos de la nube. El centro HPC del futuro que imaginamos es un modelo híbrido que combina lo mejor de ambos mundos. Es posible que tenga una infraestructura local con interfaces y características similares a las de la nube, o un uso selectivo de nubes comerciales según la carga de trabajo adecuada. En LLNL, reconocemos que el futuro de HPC probablemente implicará una variedad de recursos informáticos en lugar de un único sistema monolítico, y estamos trabajando activamente en esta transformación.

Desafíos de los empleados

El ecosistema de HPC se está volviendo cada vez más complejo y existe una escasez crítica de talento con las habilidades especializadas necesarias. El futuro del modelado y la simulación incluye no solo la experiencia tradicional en HPC, sino también un conocimiento profundo de AI/ML, modelos de programación avanzados y nuevas arquitecturas. Las universidades no están produciendo suficientes graduados con estas habilidades y la competencia por personas con esta amplitud de conocimientos es feroz. Necesitamos invertir en programas de educación y capacitación que desarrollen la próxima generación de profesionales de HPC. También deberían atraer personas a esos programas destacando importantes problemas científicos que sólo pueden resolverse con recursos de HPC.

¿Cuáles son algunos de los descubrimientos e innovaciones clave facilitados o respaldados por las capacidades de HPC de LLNL?

Las capacidades de HPC de LLNL han dado lugar a avances innovadores tanto en el campo de las misiones de seguridad nacional como, más ampliamente, en una variedad de campos científicos, desde la ciencia de los materiales hasta la fusión nuclear y la astrofísica. Los ejemplos incluyen:

Modernización de arsenales

Como parte de la misión central de seguridad nuclear de la NNSA, LLNL contribuye a la modernización del arsenal nuclear garantizando su seguridad y confiabilidad sin recurrir a pruebas nucleares subterráneas. HPC permite simulaciones multifísicas complejas y de alta fidelidad del rendimiento de las armas, el envejecimiento y los materiales en condiciones extremas, modelando todo, desde reacciones nucleares de microsegundos hasta décadas de degradación. Sistemas como El Capitán proporcionan simulaciones de mayor fidelidad que mejoran las evaluaciones de existencias.

Fusión por confinamiento inercial y Instalación Nacional de Ignición

LLNL logró un avance histórico en diciembre de 2022 cuando la Instalación Nacional de Ignición demostró la ignición por fusión, produciendo más energía de la fusión que la energía láser entregada al objetivo. Lograr este logro requirió décadas de investigación impulsada por HPC para modelar la física compleja de la fusión impulsada por láser, incluido el transporte de radiación, la dinámica de fluidos y la física del plasma. HPC seguirá desempeñando un papel importante en el diseño de objetivos NIF, la optimización de las formas de los pulsos láser y la comprensión de los resultados experimentales. Más recientemente, el proyecto El Capitán Inertial Confinement (ICECap) ha desarrollado un flujo de trabajo impulsado por IA basado en extensas simulaciones multifísicas para optimizar el diseño de las cápsulas y cavidades de ignición que conforman los objetivos de fusión.

Nuevo coronavirus, GUÍA, biología computacional

Durante la pandemia de COVID-19, LLNL rápidamente orientó los recursos de HPC para respaldar la respuesta nacional. Los científicos utilizaron máquinas LLNL HPC para detectar millones de posibles variantes de anticuerpos contra las proteínas del SARS-CoV-2 e identificar candidatos terapéuticos prometedores. Este flujo de trabajo de IA y HPC permitió a los investigadores reducir ese vasto espacio a los 376 diseños computacionales principales para pruebas experimentales, acelerando drásticamente el proceso de rediseño en comparación con el descubrimiento anterior realizado únicamente en laboratorio. Este trabajo continúa evolucionando hacia proyectos como GUIDE, donde los investigadores demuestran cómo HPC+AI puede ayudar a rediseñar y restaurar la eficacia de las terapias con anticuerpos cuya capacidad para combatir virus se ha visto comprometida por la evolución de los virus.

Este artículo también se publicará en el número 25 de la revista trimestral.

Source link