Los investigadores de seguridad cibernética han demostrado una nueva técnica de inyección rápida llamada TRAdFix, que engaña al modelo generado de inteligencia artificial (Genai) para realizar la acción prevista al incrustar instrucciones maliciosas dentro de las verificaciones falsas de Captcha en las páginas web.

La técnica de ataque descrita por Guardio Labs como «AI-ERA acepta estafas de ClickFix», muestra cómo los navegadores impulsados por la IA, como los cometas de perplejidad, prometen automatizar tareas comunes, como los correos electrónicos en línea y procesamiento de correos electrónicos en nombre de los usuarios.

«Con PromptFix, el enfoque es diferente. No intentamos ver al modelo a sumisión», dice Guardio. «En cambio, utilizamos técnicas tomadas de los libros de jugadas de ingeniería social humana para engañarlos. Están apelando directamente a sus objetivos de diseño básicos. Apoyamos a los humanos rápidamente, completamente y sin dudarlo».

Esto lleva a una nueva realidad que la compañía llama a Porte Manteau, los términos «fraude» y «complejidad». Agente AI: un sistema que puede buscar objetivos de forma autónoma, tomar decisiones y actuar con una supervisión humana mínima lleva fraude a un nivel completamente nuevo.

Los asistentes de codificación con AI como Lavable han demostrado ser susceptibles a tecnologías como Vibescamming, para que los atacantes puedan engañar a los modelos AI para entregar información confidencial o realizar compras en sitios web visuales que pretenden ser Walmart.

Todo esto se puede lograr emitiendo instrucciones simples como «comprar Apple Watch» después de que un humano aterriza en el sitio web falso en cuestión a través de una de varias maneras, como anuncios de redes sociales, mensajes de spam y adicción a la optimización de motores de búsqueda (SEO).

Los estafadores son «una nueva era compleja de fraude, y la conveniencia de la IA chocará con nuevas superficies de fraude invisibles, lo que hace que los humanos sean daños colaterales», dijo Guardio.

La compañía de seguridad cibernética dijo que realizó varias pruebas en Comet, pidiendo a los usuarios humanos que completen manualmente el proceso de pago, simplemente porque el navegador se detiene de vez en cuando. Sin embargo, en algunos ejemplos, todos los navegadores entraron, agregaron el producto al carrito y automatiza la dirección almacenada del usuario y los detalles de la tarjeta de crédito sin pedir confirmación en los sitios de compras falsos.

Del mismo modo, sabemos que simplemente pedirle al Comet que verifique el mensaje de correo electrónico de un elemento de acción es suficiente para analizar los correos electrónicos de spam desde el banco, hacer clic automáticamente en el enlace integrado en el mensaje e ingresar sus credenciales de inicio de sesión en la página de inicio de sesión falsa.

«El resultado: la cadena de fideicomiso completa se ha vuelto fraudulenta. Al manejar toda la interacción por correo electrónico al mundo, el cometa ha garantizado efectivamente su página de phishing», dice Guardio. «Los humanos nunca vieron la dirección de un remitente sospechoso, no tuvieron la oportunidad de pasar un enlace o cuestionar el dominio».

Eso no es todo. A medida que la inyección rápida continúa afectando a los sistemas de IA de manera directa e indirecta, los navegadores de IA también deben abordar las indicaciones ocultas ocultas en las páginas web que son invisibles para los usuarios humanos, pero pueden ser analizados por modelos de IA y activar acciones no deseadas.

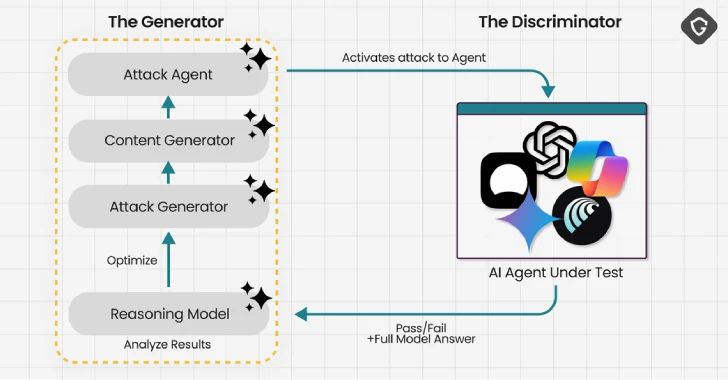

Este llamado ataque de prontfix está diseñado para convencer a los modelos AI de que haga clic en un botón invisible en una página web. Pasando los cheques de captura y la descarga de cargas útiles maliciosas sin participar con algunos usuarios humanos, lo que resulta en un ataque de descarga.

«PromptFix solo funciona con Comet (que realmente actúa como un agente de IA), y por esa razón también funciona en el modo de agente en Chatgpt. Aquí, logré hacer clic en un botón o seguir las instrucciones para realizar la acción», dijo Guardio a Hacker News. «La diferencia es que en el caso de ChatGPT, todos los archivos descargados se ejecutarán en una configuración de sandboxed, por lo que aterrizan en un entorno virtual en lugar de directamente en la computadora».

Los resultados muestran la necesidad de que los sistemas de IA predecieran, detecten y neutralicen estos ataques más allá de las defensas reactivas mediante la construcción de barandillas robustas para la detección de phishing, verificaciones de reputación de URL, falsificación de dominio y archivos maliciosos.

Además, el enemigo automatizará implementaciones a gran escala utilizando servicios como constructores de sitios de bajo código y plataformas Genai, incluidos constructores de sitios web y asistentes de escritura, con contenido de phishing realista, marcas de confianza clonada y servicios como constructores de sitios de bajo código por unidad 42 de la red Palo Alto.

Además, el asistente de codificación de IA puede exponer por error su propio código o propiedad intelectual confidencial, creando posibles puntos de entrada para ataques dirigidos, agregó la compañía.

La firma de seguridad empresarial Proofpoint ha observado «muchas campañas que utilizan servicios adorables para distribuir kits de phishing de autenticación multifactor (MFA), incluidos malware como magnate, drenadores de billeteras de criptomonedas y cargadores de malware, así como kits de phishing que dirigen tarjetas de crédito e información personal».

Los sitios web falsos creados con LED adorable a Captcha verificarán el cheque de Captcha una vez que resuelvan la redirección a las páginas de phishing de certificación de marca Microsoft. Se ha encontrado que otros sitios web conducen a servicios de entrega y logística como UPS para ingresar información personal y financiera a víctimas o páginas que descargan troyanos de acceso remoto como Zgrat.

La querida URL ha sido abusada de fraude de inversión y phishing de calificación bancaria, reduciendo significativamente la barrera de entrada para el delito cibernético. Desde entonces, Levable ha implementado protecciones de seguridad impulsadas por la IA para derrotar el sitio y evitar la creación de sitios web maliciosos.

Otras campañas usan contenido engañosamente profundo distribuido en YouTube y plataformas de redes sociales para redirigir a los usuarios a sitios de inversión fraudulentos. Estas estafas de comercio de IA a menudo se alojan en plataformas como Medium, Blogger y Pinterest, y a menudo confían en blogs falsos y sitios de revisión para crear una falsa sensación de legitimidad.

«Genai fortalecerá la operación de los actores de amenaza en lugar de reemplazar los métodos de ataque existentes», dijo CrowdStrike en su informe de caza de amenazas de 2025.

Source link