Amazon ha dado un gran golpe con Meta gracias al propio chip de Amazon. Meta firmó un acuerdo para utilizar millones de chips AWS Graviton para satisfacer sus crecientes necesidades de inteligencia artificial, anunció Amazon el viernes.

Tenga en cuenta que AWS Graviton no es una GPU (unidad de procesamiento de gráficos), sino una CPU basada en ARM (unidad central de procesamiento, un chip que maneja tareas informáticas comunes).

Las GPU siguen siendo el chip elegido para entrenar modelos grandes, pero una vez que esos modelos se entrenan, los agentes de IA construidos sobre ellos cambian el tipo de chip necesario. Los agentes crean cargas de trabajo de cómputo intensivo, como inferencia en tiempo real, escritura de código, búsqueda y coordinación necesarias para administrar agentes a través de tareas de varios pasos. La última versión de Graviton de AWS está diseñada específicamente para abordar las necesidades informáticas relacionadas con la IA, afirma la compañía.

El acuerdo devuelve gran parte del caché de Meta a AWS en lugar de a competidores como Google Cloud. En agosto pasado, Meta firmó un acuerdo de seis años y 10 mil millones de dólares con Google Cloud, pero hasta entonces Meta había sido principalmente un cliente de AWS y también utilizaba Microsoft Azure.

No pudimos evitar notar que AWS anunció este acuerdo justo cuando finalizaba la conferencia Google Cloud Next, en lo que efectivamente fue una sonrisa hacia sus rivales en la nube. Por supuesto, Google también fabrica sus propios chips de IA personalizados y anunció una nueva versión en la feria.

De hecho, Amazon también fabrica sus propias GPU con IA. Trainium, a pesar de su nombre, se utiliza tanto para entrenamiento como para inferencia. Ocurre cuando el modelo procesa activamente un mensaje después de haber sido entrenado.

Pero Anthropic ya estaba acercándose con un acuerdo anunciado a principios de este mes que se apoderaría de muchos de esos chips en los próximos años. El creador de Claude acordó gastar 100 mil millones de dólares durante 10 años para ejecutar cargas de trabajo en AWS, con un enfoque particular en Trainium, mientras que Amazon acordó invertir 5 mil millones de dólares adicionales en Anthropic a cambio (para una inversión total de 13 mil millones de dólares).

evento de crisis tecnológica

San Francisco, California

|

13-15 de octubre de 2026

En última instancia, el metaacuerdo permite a Amazon presentar a sus grandes clientes de IA como puntos de prueba para sus CPU. Estos son chips que compiten con las nuevas CPU Vera de Nvidia, que también están basadas en ARM y diseñadas para manejar cargas de trabajo de agentes de IA. La diferencia, por supuesto, es que Nvidia vende sus chips y sistemas de inteligencia artificial a empresas y proveedores de nube (incluido AWS). AWS vende acceso a chips únicamente a través de sus servicios en la nube.

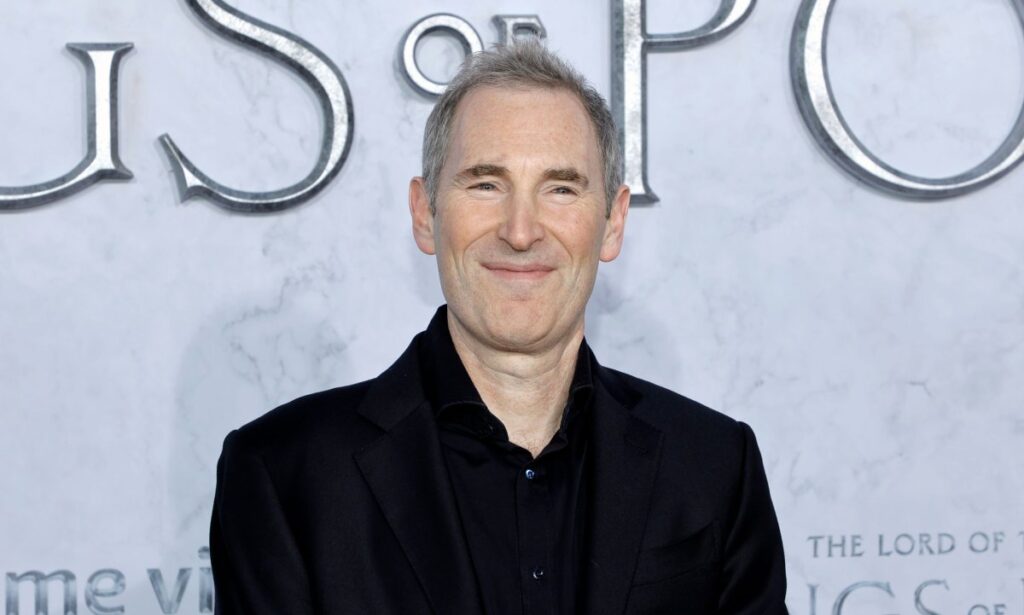

A principios de este mes, el director ejecutivo de Amazon, Andy Jassy, criticó a Nvidia e Intel en su carta anual a los accionistas, diciendo que las empresas quieren mejorar la relación precio-rendimiento de la IA y que conseguirán acuerdos sobre esa base. También significa que se está ejerciendo aún más presión sobre los equipos internos de fabricación de chips de Amazon, los que visitamos el mes pasado en un recorrido exclusivo por el laboratorio.

Si compra a través de enlaces en nuestros artículos, es posible que ganemos una pequeña comisión. Esto no afecta la independencia editorial.

Source link