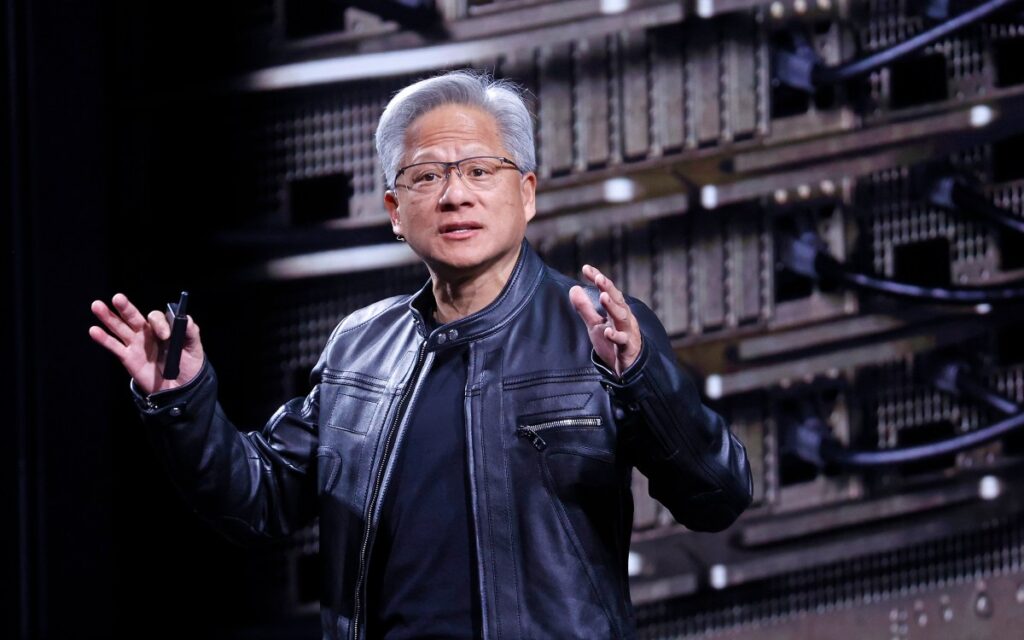

Hoy, en el Consumer Electronics Show, el director ejecutivo de Nvidia, Jensen Huang, anunció oficialmente la nueva arquitectura informática Rubin de la compañía, calificándola de lo último en hardware de IA. La nueva arquitectura está actualmente en producción y se mejorará aún más en la segunda mitad de este año.

«Vera Rubin está diseñada para abordar un desafío fundamental que tenemos: la creciente cantidad de computación requerida para la IA», dijo Huang a la audiencia. “Hoy puedo decir que Vera Rubin está en pleno funcionamiento”.

Anunciada por primera vez en 2024, la arquitectura Rubin es la última del ciclo continuo de desarrollo de hardware de Nvidia que la ha convertido en la empresa más valiosa del mundo. La arquitectura Rubin reemplaza a la arquitectura Blackwell, que reemplaza a las arquitecturas Hopper y Lovelace.

Los chips Rubin ya están programados para su uso con casi todos los principales proveedores de nube, incluidos Anthropic, OpenAI y la famosa asociación de Nvidia con Amazon Web Services. El sistema Rubin también se utilizará en la supercomputadora Blue Lion de HPE y en la próxima supercomputadora Doudna del Laboratorio Nacional Lawrence Berkeley.

La Arquitectura Rubin, que lleva el nombre de la astrónoma Vera Florence Cooper Rubin, consta de seis chips separados diseñados para funcionar juntos. Aunque las GPU Rubin están en el centro, la arquitectura también aborda los crecientes cuellos de botella en el almacenamiento y la interconexión con nuevas mejoras en los sistemas Bluefield y NVLink, respectivamente. La arquitectura también incluye una nueva CPU Vera diseñada para la inferencia de agentes.

Dion Harris, director senior de Soluciones de Infraestructura de IA de Nvidia, explicó los beneficios del nuevo almacenamiento y señaló las mayores demandas de memoria relacionadas con el almacenamiento en caché de los sistemas de IA modernos.

«A medida que nuevos tipos de flujos de trabajo comienzan a surtir efecto, como la IA del agente y las tareas de larga duración, imponen mucho estrés y requisitos a la caché KV», dijo Harris a los periodistas en una conferencia telefónica, refiriéndose al sistema de memoria utilizado por los modelos de IA para comprimir la entrada. «Por eso, introdujimos una nueva capa de almacenamiento que se conecta fuera del dispositivo informático, lo que nos permite escalar nuestro conjunto de almacenamiento de manera más eficiente».

evento de crisis tecnológica

san francisco

|

13-15 de octubre de 2026

Como era de esperar, la nueva arquitectura también muestra avances significativos en velocidad y eficiencia energética. Según las pruebas de Nvidia, la arquitectura Rubin se ejecuta 3,5 veces más rápido que la arquitectura Blackwell anterior para tareas de entrenamiento de modelos y 5 veces más rápido para tareas de inferencia, alcanzando hasta 50 petaflops. La nueva plataforma también admite 8 veces más cálculo de inferencia por vatio.

Las nuevas capacidades de Rubin llegan en medio de una feroz carrera para construir infraestructura de IA. En esta carrera, tanto los laboratorios de inteligencia artificial como los proveedores de la nube compiten por los chips Nvidia y el equipo necesario para alimentarlos. Durante una llamada sobre resultados de octubre de 2025, Huang estimó que se gastarán entre 3 y 4 billones de dólares en infraestructura de inteligencia artificial durante los próximos cinco años.

Vea la cobertura completa de TechCrunch de la conferencia anual CES aquí.